Коэффициент корреляции

Коэффициент корреляции – это величина, которая может варьировать в пределах от +1 до –1. В случае полной положительной корреляции этот коэффициент равен плюс 1 (говорят о том, что при увеличении значения одной переменной увеличивается значение другой переменной), а при полной отрицательной – минус 1 (свидетельствуют об обратной связи, т.е. При увеличении значений одной переменной, значения другой уменьшаются).

Коэффициент корреляции – это величина, которая может варьировать в пределах от +1 до –1. В случае полной положительной корреляции этот коэффициент равен плюс 1 (говорят о том, что при увеличении значения одной переменной увеличивается значение другой переменной), а при полной отрицательной – минус 1 (свидетельствуют об обратной связи, т.е. При увеличении значений одной переменной, значения другой уменьшаются).

Пр1.:

Пр1.:

График зависимости застенчивости и дипресивности. Как видим, точки (испытуемые) расположены не хаотично, а выстраиваются вокруг одной линии, причём, глядя на эту линию можно сказать, что чем выше у человека выражена застенчивость, тем больше депрессивность, т. е. эти явления взаимосвязаны.

Пр2.: График для Застенчивости и Общительности. Мы видим, что с увеличением застенчивости общительность уменьшается. Их коэффициент корреляции -0,43. Таким образом, коэффициент корреляции больший от 0 до 1 говорит о прямопропорциональной связи (чем больше… тем больше…), а коэффициент от -1 до 0 о обратнопропорциональной (чем больше… тем меньше…)

Пр2.: График для Застенчивости и Общительности. Мы видим, что с увеличением застенчивости общительность уменьшается. Их коэффициент корреляции -0,43. Таким образом, коэффициент корреляции больший от 0 до 1 говорит о прямопропорциональной связи (чем больше… тем больше…), а коэффициент от -1 до 0 о обратнопропорциональной (чем больше… тем меньше…)

В случае если коэффициент корреляции равен 0, обе переменные полностью независимы друг от друга.

В случае если коэффициент корреляции равен 0, обе переменные полностью независимы друг от друга.

Корреляционная связь - это связь, где воздействие отдельных факторов проявляется только как тенденция (в среднем) при массовом наблюдении фактических данных. Примерами корреляционной зависимости могут быть зависимости между размерами активов банка и суммой прибыли банка, ростом производительности труда и стажем работы сотрудников.

Используется две системы классификации корреляционных связей по их силе: общая и частная.

Общая классификация корреляционных связей:1) сильная, или тесная при коэффициенте корреляции r>0,70;2) средняя при 0,500,70, а не просто корреляция высокого уровня значимости.В следующей таблице написаны названия коэффициентов корреляции для различных типов шкал.

| Дихотомическая шкала (1/0) | Ранговая (порядковая) шкала | Интервальная и абсолютная шкала | |

| Дихотомическая шкала (1/0) | Коэфициент ассоциации Пирсона, коэффициент четырехклеточной сопряженности Пирсона. | Рангово-бисериальная корреляция. | Бисериальная корреляция |

| Ранговая (порядковая) шкала | Рангово-бисериальная корреляция. | Ранговый коэффициент корреляции Спирмена или Кендалла. | Значения интервальной шкалы переводятся в ранги и используется ранговый коэффициент |

| Интервальная и абсолютная шкала | Бисериальная корреляция | Значения интервальной шкалы переводятся в ранги и используется ранговый коэффициент | Коэффициент корреляции Пирсона (коэффициент линейной корреляции) |

При r=0линейная корреляционная связь отсутствует. При этом групповые средние переменных совпадают с их общими средними, а линии регрессии параллельны осям координат.

Равенство r=0говорит лишь об отсутствии линейной корреляционной зависимости (некоррелированности переменных), но не вообще об отсутствии корреляционной, а тем более, статистической зависимости.

Иногда вывод об отсутствии корреляции важнее наличия сильной корреляции. Нулевая корреляция двух переменных может свидетельствовать о том, что никакого влияния одной переменной на другую не существует, при условии, что мы доверяем результатам измерений.

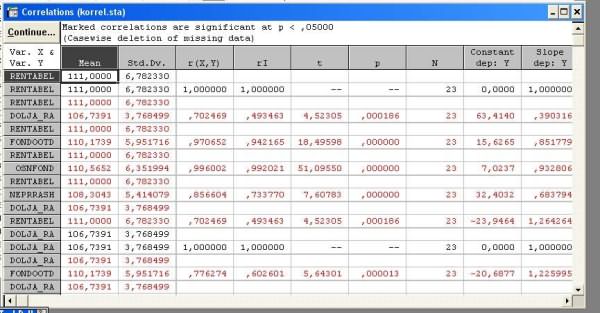

В SPSS: 11.3.2 Коэффициенты корреляции

До сих пор мы выясняли лишь сам факт существования статистической зависимости между двумя признаками. Далее мы попробуем выяснить, какие заключения можно сделать о силе или слабости этой зависимости, а также о ее виде и направленности. Критерии количественной оценки зависимости между переменными называются коэффициентами корреляции или мерами связанности. Две переменные коррелируют между собой положительно, если между ними существует прямое, однонаправленное соотношение. При однонаправленном соотношении малые значения одной переменной соответствуют малым значениям другой переменной, большие значения — большим. Две переменные коррелируют между собой отрицательно, если между ними существует обратное, разнонаправленное соотношение. При разнонаправленном соотношении малые значения одной переменной соответствуют большим значениям другой переменной и наоборот. Значения коэффициентов корреляции всегда лежат в диапазоне от -1 до +1.

В качестве коэффициента корреляции между переменными, принадлежащими порядковой шкале применяется коэффициент Спирмена, а для переменных, принадлежащих к интервальной шкале — коэффициент корреляции Пирсона (момент произведений). При этом следует учесть, что каждую дихотомическую переменную, то есть переменную, принадлежащую к номинальной шкале и имеющую две категории, можно рассматривать как порядковую.

Для начала мы проверим существует ли корреляция между переменными sex и psyche из файла studium.sav. При этом мы учтем, что дихотомическую переменную sex можно считать порядковой. Выполните следующие действия:

· Выберите в меню команды Analyze (Анализ) Descriptive Statistics (Дескриптивные статистики) Crosstabs... (Таблицы сопряженности)

· Перенесите переменную sex в список строк, а переменную psyche — в список столбцов.

· Щелкните на кнопке Statistics... (Статистика). В диалоге Crosstabs: Statistics установите флажок Correlations (Корреляции). Подтвердите выбор кнопкой Continue.

· В диалоге Crosstabs откажитесь от вывода таблиц, установив флажок Supress tables (Подавлять таблицы). Щелкните на кнопке ОК.

Будут вычислены коэффициенты корреляции Спирмена и Пирсона, а также проведена проверка их значимости:

studopedia.ru

/ СПСС 10

Задание № 10 Корреляционный анализ

Понятие корреляции

Корреляция или коэффициент корреляции – это статистический показательвероятностнойсвязи между двумя переменными, измеренными по количественным шкалам. В отличие от функциональной связи, при которой каждому значению одной переменной соответствуетстрого определенноезначение другой переменной,вероятностная связьхарактеризуется тем, что каждому значению одной переменной соответствуетмножество значенийдругой переменной, Примером вероятностной связи является связь между ростом и весом людей. Ясно, что один и тот же рост может быть у людей разного веса и наоборот.

Корреляция представляет собой величину, заключенную в пределах от -1 до + 1, и обозначается буквой r. Причем, если значение находится ближе к 1, то это означает наличие сильной связи, а если ближе к 0, то слабой. Значение корреляции менее 0,2 рассматривается как слабая корреляция, свыше 0,5 – высокая. Если коэффициент корреляции отрицательный, это означает наличие обратной связи: чем выше значение одной переменной, тем ниже значение другой.

В зависимости от принимаемых значений коэффициента rможно выделить различные виды корреляции:

Строгая положительная корреляцияопределяется значениемr=1. Термин «строгая» означает, что значение одной переменной однозначно определяются значениями другой переменной, а термин «положительная» - что с возрастанием значений одной переменной значения другой переменной также возрастают.

Строгая корреляция является математической абстракцией и практически не встречается в реальных исследованиях.

Положительная корреляция соответствует значениям 0

Отсутствие корреляцииопределяется значениемr=0. Нулевой коэффициент корреляции говорит о том, что значения переменных никак не связаны между собой.

Отсутствие корреляции Ho: 0rxy=0формулируется как отражениенулевой гипотезы в корреляционном анализе.

Отрицательная корреляция: -1

Строгая отрицательная корреляцияопределяется значениемr= -1. Она также, как и строгая положительная корреляция, является абстракцией и не находит выражение в практических исследованиях.

Таблица 1

Виды корреляции и их определения

|

Виды |

Определения |

|

Строгая положительная корреляция |

r=1 |

|

Положительная корреляция |

0< r |

|

Отсутствие корреляции |

r=0. |

|

Отрицательная корреляция |

-1 |

|

Строгая отрицательная корреляция |

r= -1 |

Метод вычисления коэффициента корреляции зависит от вида шкалы, по которой измерены значения переменной.

Коэффициент корреляции rПирсонаявляется основным и может использоваться для переменных с номинальной и частично упорядоченными, интервальными шкалами, распределение значений по которым соответствует нормальному (корреляция моментов произведения). Коэффициент корреляции Пирсона дает достаточно точные результаты и в случаях анормальных распределений.

Для распределений, не являющихся нормальными, предпочтительнее пользоваться коэффициентами ранговой корреляции Спирмена и Кендалла. Ранговыми они являются потому, что программа предварительно ранжирует коррелируемые переменные.

Корреляцию rСпирмена программаSPSSвычисляет следующим образом: сначала переменные переводятся в ранги, а затем к рангам применяется формулаrПирсона.

В основе корреляции, предложенной М. Кендаллом, лежит идея о том, что о направлении связи можно судить, попарно сравнивая между собой испытуемых. Если у пары испытываемых изменение по Х совпадают по направлению с изменением по Yсовпадает, то это свидетельствует о положительной связи. Если не совпадает – то об отрицательной связи. Данный коэффициент применяется преимущественно психологами, работающими с малыми выборками. Так как социологи работают с большими массивами данных, то перебор пар, выявление разности относительных частот и инверсий всех пар испытуемых в выборке затруднителен. Наиболее распространенным является коэф. Пирсона.

Поскольку коэффициент корреляции rПирсона является основным и может использоваться (с некоторой погрешностью в зависимости от типа шкалы и уровня анормальности в распределении) для всех переменных, измеренных по количественным шкалам, рассмотрим примеры его использования и сравним полученные результаты с результатами измерений по другим коэффициентам корреляции.

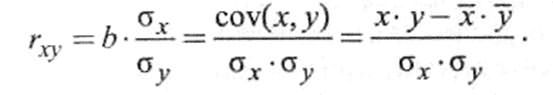

Формула вычисления коэффициента r- Пирсона:

rxy= ∑ (Xi-Xср)∙(Yi-Yср) / (N-1)∙σx∙σy∙

Где: Xi, Yi- Значения двух переменных;

Xср, Yср- средние значения двух переменных;

σx,σy– стандартные отклонения,

N- количество наблюдений.

Парные корреляции

Например, мы хотели бы выяснить, как соотносятся ответы между различными видами традиционных ценностей в представлениях студентов об идеальном месте работы (переменные: а9.1, а9.3, а9.5, а9.7), а затем о соотношении либеральных ценностях (а9.2, а9.4. а9.6, а9.8) . Данные переменные измерены по 5 – членным упорядоченным шкалам.

Используем процедуру: «Анализ», «Корреляции»,«Парные». По умолчанию коэф. Пирсона установлен в диалоговом окне. Используем коэф. Пирсона

.В окно отбора переносятся тестируемые переменные: а9.1, а9.3, а9.5, а9.7

Путем нажатия ОК получаем расчет:

Корреляции

|

а9.1.т. Насколько важно иметь достаточно времени для семьи и личной жизни? |

а9.3.т. Насколько важно не бояться потерять свою работу? |

а9.5.т. Насколько важно иметь такого начальника, который будет советоваться с Вами, принимая то или иное решение ? |

а9.7.т. Насколько важно работать в слаженном коллективе, ощущать себя его частью? |

||

|

а9.1.т. Насколько важно иметь достаточно времени для семьи и личной жизни? |

Корреляция Пирсона |

1 |

,138(**) |

,040 |

,157(**) |

|

Знч.(2-сторон) |

,003 |

,389 |

,001 |

||

|

N |

458 |

452 |

458 |

451 |

|

|

а9.3.т. Насколько важно не бояться потерять свою работу? |

Корреляция Пирсона |

,138(**) |

1 |

,202(**) |

,188(**) |

|

Знч.(2-сторон) |

,003 |

,000 |

,000 |

||

|

N |

452 |

460 |

459 |

453 |

|

|

а9.5.т. Насколько важно иметь такого начальника, который будет советоваться с Вами, принимая то или иное решение ? |

Корреляция Пирсона |

,040 |

,202(**) |

1 |

,193(**) |

|

Знч.(2-сторон) |

,389 |

,000 |

,000 |

||

|

N |

458 |

459 |

465 |

458 |

|

|

а9.7.т. Насколько важно работать в слаженном коллективе, ощущать себя его частью? |

Корреляция Пирсона |

,157(**) |

,188(**) |

,193(**) |

1 |

|

Знч.(2-сторон) |

,001 |

,000 |

,000 |

||

|

N |

451 |

453 |

458 |

460 |

** Корреляция значима на уровне 0.01 (2-сторон.).

Таблица количественных значений построенной корреляционной матрицы

|

Признаки |

Количество |

|

Размер корреляционной матрицы |

4×4 |

|

Количество коэффициентов корреляции |

6 |

|

Количество значимых коэффициентов корреляции (при Р |

5 |

|

В т.ч. с положительной связью |

5 |

|

В т.ч. с отрицательной связью |

0 |

Частные корреляции:

Для начала построим парную корреляцию между указанными двумя переменными:

|

Корреляции |

|||

|

с8. Ощущают близость с теми, кто живет рядом с вами, соседями |

с12. Ощущают близость со своей семьей |

||

|

с8. Ощущают близость с теми, кто живет рядом с вами, соседями |

Корреляция Пирсона |

1 |

,120** |

|

Знч.(2-сторон) |

,001 |

||

|

N |

718 |

698 |

|

|

с12. Ощущают близость со своей семьей |

Корреляция Пирсона |

,120** |

1 |

|

Знч.(2-сторон) |

,001 |

||

|

N |

698 |

748 |

|

|

**. Корреляция значима на уровне 0.01 (2-сторон.). |

|||

Затем используем процедуру построения частной корреляции: «Анализ», «Корреляции»,«Частные».

Предположим, что ценность «Важно самостоятельно определять и изменять порядок своей работы» во взаимосвязи с указанными переменными окажется тем решающим фактором, под влияние которого ранее выявленная связь исчезнет, либо окажется малозначимой.

|

Корреляции |

||||

|

Исключенные переменные |

с8. Ощущают близость с теми, кто живет рядом с вами, соседями |

с12. Ощущают близость со своей семьей |

||

|

с16. Ощущают близость с людьми, котрые имеют тот же достаток, что и вы |

с8. Ощущают близость с теми, кто живет рядом с вами, соседями |

Корреляция |

1,000 |

,102 |

|

Значимость (2-сторон.) |

. |

,012 |

||

|

ст.св. |

0 |

599 |

||

|

с12. Ощущают близость со своей семьей |

Корреляция |

,102 |

1,000 |

|

|

Значимость (2-сторон.) |

,012 |

. |

||

|

ст.св. |

599 |

0 |

||

Как видно из таблицы под влиянием контрольной переменной связь несколько снизилась: с 0, 120 до 0, 102. Однако, это незначительно снижение не позволяет утверждать, что ране выявленная связь является отражением ложной корреляции, т.к. она остается достаточно высокой и позволяет с нулевой погрешностью опровергать нулевую гипотезу.

StudFiles.ru

Коэффициент корреляции

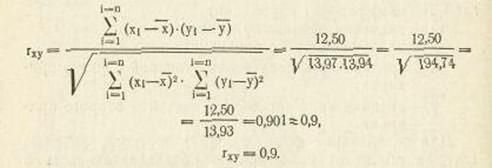

Наиболее точный способ определения тесноты и характера корреляционной связи - нахождение коэффициента корреляции. Коэффициент корреляции есть число определяемое по формуле:

где rху— коэффициент корреляции;

xi—значения первого признака;

уi—значения второго признака;

—средняя арифметическая значений первого признака

—средняя арифметическая значений первого признака

средняя арифметическая значений второго признака

средняя арифметическая значений второго признака

Для пользования формулой (32) построим таблицу, которая обеспечит необходимую последовательность в подготовке чисел для нахождения числителя и знаменателя коэффициента корреляции.

Как видно из формулы (32), последовательность действий такая: находим средние арифметические обоих признаков х и у, находим разность между значениями признака и его средней (хі-  ) и уі-

) и уі-  ), затем находим их произведение (хі-

), затем находим их произведение (хі-  ) (уі-

) (уі-  ) – суммa пocлeдних дает числитель коэффициента корреляции. Для нахождения его знаменателя следует разности (xi—

) – суммa пocлeдних дает числитель коэффициента корреляции. Для нахождения его знаменателя следует разности (xi—  )и (уі -

)и (уі -  ) возвести в квадрат, найти их суммы и извлечь корень квадратный из их произведения.

) возвести в квадрат, найти их суммы и извлечь корень квадратный из их произведения.

Так для примера 31 нахождение коэффициента корреляции в соответствии с формулой (32) можно представить следующим образом (табл. 50).

Полученное число коэффициента корреляции дает возможность установить наличие, тесноту и характер связи.

1. Если коэффициент корреляции равен нулю, связь между признаками отсутствует.

2. Если коэффициент корреляции равен единице, связь между признаками столь велика, что превращается в функциональную.

3. Абсолютная величина коэффициента корреляции не выходит за пределы интервала от нуля до единицы:

0xy|

Это дает возможность ориентироваться на тесноту связи: чем величина коэффициента ближе к нулю, тем связь слабее, а чем ближе к единице, тем связь теснее.

4. Знак коэффициента корреляции «плюс» означает прямую корреляцию, знак «минус»—обратную.

Таблица50

| хі | уі | (хі-  ) ) |

(уі-  ) ) |

(хі-  )(уі- )(уі-  ) ) |

(хі-  )2 )2 |

(уі-  )2 )2 |

| 14,00 | 12,10 | —1,70 | —2,30 | +3,91 | 2,89 | 5,29 |

| 14,20 | 13,80 | —1,50 | —0,60 | +0,90 | 2,25 | 0,36 |

| 14,90 | 14,20 | —0,80 | —0,20 | +0,16 | 0,64 | 0,04 |

| 15,40 | 13,00 | —0,30 | —1,40 | +0,42 | 0,09 | 1,96 |

| 16,00 | 14,60 | +0,30 | +0,20 | +0,06 | 0,09 | 0,04 |

| 17,20 | 15,90 | +1,50 | +2,25 | 2,25 | ||

| 18,10 | 17,40 | +2,40 | +2,00 | +4,80 | 5,76 | 4,00 |

| 109,80 | 101,00 | 12,50 | 13,97 | 13,94 |

Таким образом, вычисленный в примере 31 коэффициент корреляции rxy = +0,9. позволяет сделать такие выводы: существует корреляционная связь между величиной мышечной силы правой и левой кистей у исследуемых школьников (коэффициент rxy =+0,9 отличен от нуля), связь очень тесная (коэффициент rxy =+0,9 близок к единице), корреляция прямая (коэффициент rxy = +0,9 положителен), т. е. с увеличением мышечной силы одной из кистей увеличивается сила другой кисти.

При вычислении коэффициента корреляции и пользовании его свойствами следует учесть, что выводы дают корректные результаты в том случае, когда признаки распределены нормально и когда рассматривается взаимосвязь между большим количеством значений обоих признаков.

В рассмотренном примере 31 анализированы только 7 значений обоих признаков, что, конечно, недостаточно для подобных исследований. Напоминаем здесь еще раз, что примеры, в данной книге вообще и в этой главе в частности, носят характер иллюстрации методов, а не подробного изложения каких-либо научных экспериментов. Вследствие этого рассмотрено небольшое число значений признаков, измерения округлены — все это делается для того, чтобы громоздкими вычислениями не затемнять идею метода.

Особое внимание следует обратить на существо рассматриваемой взаимосвязи. Коэффициент корреляции не может привести к верным результатам исследования, если анализ взаимосвязи между признаками проводится формально. Возвратимся еще раз к примеру 31. Оба рассмотренных признака представляли собой значения мышечной силы правой и левой кистей. Представим себе, что под признаком xi в примере 31 (14,0; 14,2; 14,9... ...18,1) мы понимает длину случайно пойманных рыб в сантиметрах, а под признаком уі (12,1; 13,8; 14,2... ...17,4) —вес приборов в лаборатории в килограммах. Формально воспользовавшись аппаратом вычислений для нахождения коэффициента корреляции и получив в этом случае также rxy =+0>9, мы должны были заключить, что между длиной рыб и весом приборов существует тесная связь прямого характера. Бессмысленность такого вывода очевидна.

Чтобы избежать формального подхода к пользованию коэффициентом корреляции, следует любым другим методом — математическим, логическим, экспериментальным, теоретическим — выявить возможность существования корреляционной связи между признаками, то есть обнаружить органическое единство признаков. Только после этого можно приступать к пользованию корреляционным анализом и устанавливать величину и характер взаимосвязи.

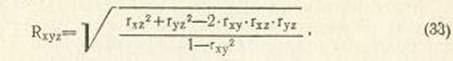

В математической статистике существует еще понятие множественной корреляции — взаимосвязи между тремя и более признаками. В этих случаях пользуются коэффициентом множественной корреляции, состоящим из парных коэффициентов корреляции, описанных выше.

Например, коэффициент корреляции трех признаков—хі, уі, zі — есть:

где Rxyz—коэффициент множественной корреляции, выражающий, как признак хi зависит от признаков уі и zi;

rxy —коэффициент корреляции между признаками xi и yi;

rxz—коэффициент корреляции между признаками Xi и Zi;

ryz—коэффициент корреляции между признаками yi, zi

studopedia.ru

Корреляционный анализ это:

Корреляционный анализКорреля́ция — статистическая взаимосвязь двух или нескольких случайных величин (либо величин, которые можно с некоторой допустимой степенью точности считать таковыми). При этом, изменения одной или нескольких из этих величин приводят к систематическому изменению другой или других величин. Математической мерой корреляции двух случайных величин служит коэффициент корреляции.

Корреляция может быть положительной и отрицательной (возможна также ситуация отсутствия статистической взаимосвязи — например, для независимых случайных величин). Отрицательная корреляция — корреляция, при которой увеличение одной переменной связано с уменьшением другой переменной, при этом коэффициент корреляции отрицателен. Положительная корреляция — корреляция, при которой увеличение одной переменной связано с увеличением другой переменной, при этом коэффициент корреляции положителен.

Автокорреляция — статистическая взаимосвязь между случайными величинами из одного ряда, но взятых со сдвигом, например, для случайного процесса — со сдвигом по времени.

Метод обработки статистических данных, заключающийся в изучении коэффициентов (корреляции) между переменными, называется корреляционным анализом.

Содержание

|

Коэффициент корреляции

Коэффицие́нт корреля́ции или парный коэффицие́нт корреля́ции в теории вероятностей и статистике — это показатель характера изменения двух случайных величин. Коэффициент корреляции обозначается латинской буквой R и может принимать значения между -1 и +1. Если значение по модулю находится ближе к 1, то это означает наличие сильной связи (при коэффициенте корреляции равном единице говорят о функциональной связи), а если ближе к 0, то слабой.

Коэффициент корреляции Пирсона

Для метрических величин применяется коэффициент корреляции Пирсона, точная формула которого была введена Фрэнсисом Гальтоном:

Пусть X,Y — две случайные величины, определённые на одном вероятностном пространстве. Тогда их коэффициент корреляции задаётся формулой:

![\R_{X,Y} = \frac{\mathrm{cov}(X,Y)}{\sqrt{\mathrm{D}[X]} \cdot \sqrt{\mathrm{D}[Y]}}](http://i.zna4enie.ru/1/znachenie-kojefficienta-korreljacii_10.png) ,

,

где cov обозначает ковариацию, а D — дисперсию, или, что то же самое,

![\R_{X,Y} = \frac{\mathbb{E}[XY]-\mathbb{E}X \cdot \mathbb{E}Y} {\sqrt{(\mathbb{E}[X^2]-(\mathbb{E}X)^2)} \cdot \sqrt{ (\mathbb{E}[Y^2]-(\mathbb{E}Y)^2)}}](http://i.zna4enie.ru/1/znachenie-kojefficienta-korreljacii_11.png) ,

,

где символ  обозначает математическое ожидание.

обозначает математическое ожидание.

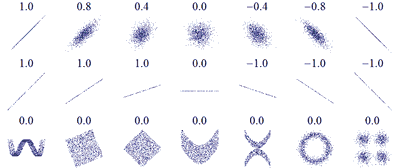

Для графического представления подобной связи можно использовать прямоугольную систему координат с осями, которые соответствуют обеим переменным. Каждая пара значений маркируется при помощи определенного символа. Такой график называется «диаграммой рассеяния».

Метод вычисления коэффициента корреляции зависит от вида шкалы, к которой относятся переменные. Так, для измерения переменных с интервальной и количественной шкалами необходимо использовать коэффициент корреляции Пирсона (корреляция моментов произведений). Если по меньшей мере одна из двух переменных имеет порядковую шкалу, либо не является нормально распределённой, необходимо использовать ранговую корреляцию Спирмена или τ (тау) Кендала. В случае, когда одна из двух переменных является дихотомической, используется точечная двухрядная корреляция, а если обе переменные являются дихотомическими: четырёхполевая корреляция. Расчёт коэффициента корреляции между двумя недихотомическими переменными не лишён смысла только тогда, кода связь между ними линейна (однонаправлена).

Коэффициент корреляции Кенделла

Используется для измерения взаимной неупорядоченности.

Коэффициент корреляции Спирмена

Свойства коэффициента корреляции

- Неравенство Коши — Буняковского:

, то норма случайной величины будет равна

, то норма случайной величины будет равна ![\|X\| = \sqrt{\mathrm{D}[X]}](http://i.zna4enie.ru/a/znachenie-kojefficienta-korreljacii_14.png) , и следствием неравенства Коши — Буняковского будет:

, и следствием неравенства Коши — Буняковского будет:  .

.

- Коэффициент корреляции равен

тогда и только тогда, когда X и Y линейно зависимы:

тогда и только тогда, когда X и Y линейно зависимы:

, где

, где  . Более того в этом случае знаки

. Более того в этом случае знаки  и k совпадают:

и k совпадают:  .

.

- Если X,Y независимые случайные величины, то

. Обратное в общем случае неверно.

. Обратное в общем случае неверно.

Корреляционный анализ

Корреляционный анализ — метод обработки статистических данных, заключающийся в изучении коэффициентов (корреляции) между переменными. При этом сравниваются коэффициенты корреляции между одной парой или множеством пар признаков для установления между ними статистических взаимосвязей.

Цель корреляционного анализа — обеспечить получение некоторой информации об одной переменной с помощью другой переменной. В случаях, когда возможно достижение цели, говорят, что переменные коррелируют. В самом общем виде принятие гипотезы о наличии корреляции означает что изменение значения переменной А, произойдет одновременно с пропорциональным изменением значения Б: если обе переменные растут то корреляция положительная, если одна переменная растёт, а вторая уменьшается, корреляция отрицательная.

Корреляция отражает лишь линейную зависимость величин, но не отражает их функциональной связности. Например, если вычислить коэффициент корреляции между величинами A = sin(x) и B = cos(x), то он будет близок к нулю, т. е. зависимость между величинами отсутствует. Между тем, величины A и B очевидно связаны функционально по закону sin2(x) + cos2(x) = 1.

Ограничения корреляционного анализа

Графики распределений пар (x,y) с соответствующими коэффициентами корреляций x и y для каждого из них. Обратите внимание, что коэффициент корреляции отражает линейную зависимость (верхняя строка), но не описывает кривую зависимости (средняя строка), и совсем не подходит для описания сложных, нелинейных зависимостей (нижняя строка).

Графики распределений пар (x,y) с соответствующими коэффициентами корреляций x и y для каждого из них. Обратите внимание, что коэффициент корреляции отражает линейную зависимость (верхняя строка), но не описывает кривую зависимости (средняя строка), и совсем не подходит для описания сложных, нелинейных зависимостей (нижняя строка).

- Применение возможно в случае наличия достаточного количества случаев для изучения: для конкретного вида коэффициента корреляции составляет от 25 до 100 пар наблюдений.

- Второе ограничение вытекает из гипотезы корреляционного анализа, в которую заложена линейная зависимость переменных. Во многих случаях, когда достоверно известно, что зависимость существует, корреляционный анализ может не дать результатов просто ввиду того, что зависимость нелинейна (выражена, например, в виде параболы).

- Сам по себе факт корреляционной зависимости не даёт основания утверждать, какая из переменных предшествует или является причиной изменений, или что переменные вообще причинно связаны между собой, например, ввиду действия третьего фактора.

Область применения

Данный метод обработки статистических данных весьма популярен в экономике и социальных науках (в частности в психологии и социологии), хотя сфера применения коэффициентов корреляции обширна: контроль качества промышленной продукции, металловедение, агрохимия, гидробиология, биометрия и прочие.

Популярность метода обусловлена двумя моментами: коэффициенты корреляции относительно просты в подсчете, их применение не требует специальной математической подготовки. В сочетании с простотой интерпретации, простота применения коэффициента привела к его широкому распространению в сфере анализа статистических данных.

Ложная корреляция

Часто заманчивая простота корреляционного исследования подталкивает исследователя делать ложные интуитивные выводы о наличии причинно-следственной связи между парами признаков, в то время как коэффициенты корреляции устанавливают лишь статистические взаимосвязи.

В современной количественной методологии социальных наук, фактически, произошел отказ от попыток установить причинно-следственные связи между наблюдаемыми переменными эмпирическими методами. Поэтому, когда исследователи в социальных науках говорят об установлении взаимосвязей между изучаемыми переменными, подразумевается либо общетеоретическое допущение, либо статистическая зависимость.

См. также

- Автокорреляционная функция

- Взаимнокорреляционная функция

- Ковариация

- Коэффициент детерминации

- Регрессионный анализ

Wikimedia Foundation. 2010.

dic.academic.ru

Читайте также

![Коэффициент концентрации привлеченного капитала нормативное значение Коэффициент концентрации привлеченного капитала нормативное значение]() Коэффициент концентрации привлеченного капитала нормативное значение

Коэффициент концентрации привлеченного капитала нормативное значение![Коэффициент абсолютной ликвидности нормативное значение Коэффициент абсолютной ликвидности нормативное значение]() Коэффициент абсолютной ликвидности нормативное значение

Коэффициент абсолютной ликвидности нормативное значение![Корреляция значения Корреляция значения]() Корреляция значения

Корреляция значения![Расчет коэффициента детерминации невозможен без значения коэффициента Расчет коэффициента детерминации невозможен без значения коэффициента]() Расчет коэффициента детерминации невозможен без значения коэффициента

Расчет коэффициента детерминации невозможен без значения коэффициента![Значения коэффициентов корреляции графиков нагрузки потребителей Значения коэффициентов корреляции графиков нагрузки потребителей]() Значения коэффициентов корреляции графиков нагрузки потребителей

Значения коэффициентов корреляции графиков нагрузки потребителей![Коэффициент корреляции может принимать значения Коэффициент корреляции может принимать значения]() Коэффициент корреляции может принимать значения

Коэффициент корреляции может принимать значения![Аутентичность значение слова Аутентичность значение слова]() Аутентичность значение слова

Аутентичность значение слова![Чувак значение слова с еврейского Чувак значение слова с еврейского]() Чувак значение слова с еврейского

Чувак значение слова с еврейского- 7 Треф значение

![Славянские имена мальчиков и их значение Славянские имена мальчиков и их значение]() Славянские имена мальчиков и их значение

Славянские имена мальчиков и их значение![Барыга значение слова википедия Барыга значение слова википедия]() Барыга значение слова википедия

Барыга значение слова википедия![Амбициозный значение слова Амбициозный значение слова]() Амбициозный значение слова

Амбициозный значение слова

тогда и только тогда, когда X и Y линейно зависимы:

тогда и только тогда, когда X и Y линейно зависимы: . Обратное в общем случае неверно.

. Обратное в общем случае неверно. Коэффициент концентрации привлеченного капитала нормативное значение

Коэффициент концентрации привлеченного капитала нормативное значение Коэффициент абсолютной ликвидности нормативное значение

Коэффициент абсолютной ликвидности нормативное значение Корреляция значения

Корреляция значения Расчет коэффициента детерминации невозможен без значения коэффициента

Расчет коэффициента детерминации невозможен без значения коэффициента Значения коэффициентов корреляции графиков нагрузки потребителей

Значения коэффициентов корреляции графиков нагрузки потребителей Коэффициент корреляции может принимать значения

Коэффициент корреляции может принимать значения Аутентичность значение слова

Аутентичность значение слова Чувак значение слова с еврейского

Чувак значение слова с еврейского Славянские имена мальчиков и их значение

Славянские имена мальчиков и их значение Барыга значение слова википедия

Барыга значение слова википедия Амбициозный значение слова

Амбициозный значение слова